ディープフェイクとは?活用方法・3大リスクと対策・事例も紹介

更新日:

「ディープフェイク」とはAIのディープラーニング技術を活用し、実際には存在しない人物の動画や画像を生成する技術です。

ディープフェイクは、詐欺やフェイクニュースの拡散などに悪用されるなどネガティブなイメージもありますが、マーケティングや映画、顧客対応など様々な場面で活用することができる便利な技術です。

本記事では、ディープフェイクについて一から学びたい方向けに、ディープフェイクの基本から活用事例、リスクと対策までわかりやすくご紹介します。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

目次

ディープフェイクとは

ディープフェイクとは、「ディープラーニング」と「フェイク」を組み合わせて作られた造語で、AIを用いて、本物そっくりの架空の映像や音声を作成する技術です。

人の顔や声を非常にリアルに模倣することができるため、実際には存在しない人物の動画や、著名人が言ったことのない言葉を話す動画を作ることができます 。

ディープフェイクは、広告・マーケティング向けの映像・音声の作成や映画などの動画コンテンツ制作など多岐にわたり活用されています。

しかし、本物そっくりの映像を比較的容易に作り出せることから、虚偽情報の拡散、詐欺、名誉毀損、プライバシー侵害など、様々なリスクも存在するため、倫理やモラルにのっとった活用をしていくことが求められています。

※生成AI/ChatGPTの活用を検討する際に必ず押さえておきたい、基礎知識から活用の進め方、ポイントまでをまとめた資料をダウンロード頂けます。

⇒【ゼロから分かる】生成AI/ChatGPT活用ガイドブックの資料ダウンロードはこちら(無料)

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

ディープフェイクを活用する3つの方法

ディープフェイクを活用する方法として、主に以下の3つが挙げられます。

- ①広告・マーケティングへの活用

- ②映画などの動画コンテンツ制作への活用

- ③顧客からの問い合わせ対応への活用

それぞれについてわかりやすく紹介していきます。

※200事例の分析に基づく、企業の生成AI/ChatGPT活用方法の9つの定石と最新事例をまとめた資料をダウンロード頂けます。

⇒生成AI/ChatGPTの活用アイデア集の資料ダウンロードはこちら(無料)

①広告・マーケティングへの活用

ディープフェイクにより本物そっくりの人物の映像や音声を再現し、商品やサービスを宣伝させるなど、広告・マーケティングに活用することができます。

本物の著名人を起用することにより発生する費用を削減できるなど、費用を抑えつつ、広告効果を最大限発揮することができます。

②映画などの動画コンテンツ制作への活用

ディープフェイクは、映画やドラマなどの動画コンテンツの制作にも活用することができます。

俳優に現実ではありえない動きをさせたり、架空の人物を作り出して演技させたりするなど、従来の技術では難しかった映像の制作も可能となり、表現の幅が広がります。

③顧客からの問い合わせ対応への活用

ディープフェイクにより架空の人物や音声を作り出し、顧客からの問い合わせ対応に活用することができます。

これにより、人件費などのコストを削減できることに加え、24時間いつでも顧客とのやり取りができるようになり、サービスの質が向上します。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

【2024年最新】ディープフェイクの活用事例3選

ディープフェイクの活用事例として、以下の3つが挙げられます。

- ①中国のライブコマースでアバターが商品を宣伝

- ②有名人のクローンと会話できるサービスの提供

- ③オーストラリアの映像作家が短編映画にディープフェイクを試用

それぞれの事例についてわかりやすく紹介していきます。

※国内外の最新生成AI/ChatGPT活用事例50選をまとめた資料をダウンロード頂けます。

⇒生成AI/ChatGPT活用事例50選の資料ダウンロードはこちら(無料)

①中国のライブコマースでアバターが商品を宣伝

ライブコマースとは、著名人やインフルエンサーが企業の商品やサービスをライブ配信という形で紹介し、報酬を受け取るというマーケティング手法であり、特に中国で流行しています。

このライブコマースにもディープフェイクが使われており、AIにより生み出された本物そっくりの架空の人物に商品を宣伝させています。

ディープフェイクによって作られたAIのアバターに24時間無休で商品の宣伝をさせ、一晩で数億ドルを稼ぐインフルエンサーも現れるなど、ビジネスの世界に大きな影響を与えています。

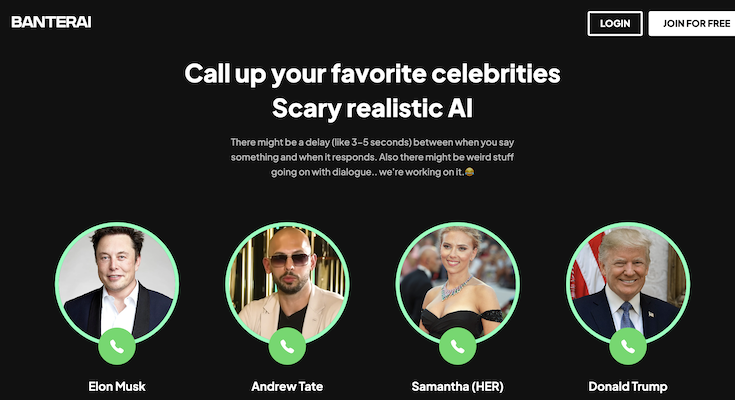

②有名人のクローンと会話できるサービスの提供

ディープフェイクにより有名人の音声を再現し、あたかも本物の有名人と会話しているかのような体験を楽しむことができるサービスがリリースされています。

代表的なサービスとして、BanterAIが挙げられます。BanterAIでは、俳優、ミュージシャン、政治家、歴史上の偉人など様々な人物の音声が再現され、自然な会話を楽しめる内容となっています。

このように、ディープフェイクを活用したエンタメコンテンツとしてのサービスは今後もますます普及していくと考えられます。

③オーストラリアの映像作家が短編映画にディープフェイクを試用

オーストラリア出身の映像作家ニコラス・ガーディナー氏は、「Proxy」という短編映画のある場面において、ディープフェイクを活用した実験を行いました。

映画内では、米国元大統領ドナルド・トランプ氏の映像が、ディープフェイクを用いて加工され、中国の習近平国家主席の顔にすり替わっています。

このように、すでに映画界でもディープフェイクを活用する試みが行われており、今までは技術的に困難だった映像の制作も可能になると考えられます。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

ディープフェイクの悪用による3大リスク

ディープフェイクの悪用によるリスクとして、主に以下のXつが挙げられます。

- ①オレオレ詐欺等の被害

- ②フェイクニュースの拡散

- ③名誉やプライバシーの侵害

それぞれについてわかりやすく紹介していきます。

※生成AI/ChatGPTを導入する前に必ず押さえておきたい、主要なリスクと具体的な対策をまとめた資料をダウンロード頂けます。

⇒生成AI/ChatGPT導入のリスクと対策ガイドブックの資料ダウンロードはこちら(無料)

①オレオレ詐欺等の被害

ディープフェイクにより、本物そっくりの声や映像を再現することができるため、他人へのなりすましが容易になります。

これにより、家族や友人になりすまして金銭をだましとるオレオレ詐欺等の被害が発生するリスクが高まります。

②フェイクニュースの拡散

ディープフェイクを用いて、著名人が事実と異なる発言をする映像を捏造するなどして、フェイクニュースを拡散させることが可能となってしまいます。

特に、政治家の発言を捏造することで、民衆の政治的意見にも影響を及ぼすなど、深刻な事態につながる可能性もあります。

③名誉やプライバシーの侵害

ディープフェイクにより、著名人のスキャンダル映像を捏造したり、個人のプライバシーに関わる事項を暴露させる映像を制作するなど、人の名誉やプライバシーを侵害するような行為が横行するリスクがあります。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

【2024年最新】ディープフェイクが悪用された事例3選

ディープフェイクが悪用された事例として、以下の3つが挙げられます。

- ①香港の企業の担当者がディープフェイクの同僚に騙され38億円を送金

- ②偽物のゼレンスキー大統領が降伏を呼びかける動画が拡散

- ③FBIが採用面接でのディープフェイク悪用に対する注意を呼びかけ

それぞれの事例についてわかりやすく紹介していきます。

①香港の企業の担当者がディープフェイクの同僚に騙され38億円を送金

香港の多国籍企業の財務担当者が、生成AIで合成された同僚の姿を悪用したビデオ通話に騙され、約38億円を送金する事件が発生しました。

香港警察によると、担当者が参加したテレビ会議の映像と音声はいずれもAIを利用して合成・複製された偽物(ディープフェイク)だったとのことです。

この事件は、ディープフェイク技術を利用した初の大規模な詐欺として注目を集めています。

②偽物のゼレンスキー大統領が降伏を呼びかける動画が拡散

ウクライナとロシアによる戦争の最中、ウクライナの大統領であるゼレンスキー氏が降伏を呼びかける偽物の動画がFacebookなどのSNS上で拡散されました。

動画では、本物そっくりのゼレンスキー氏が国民に降伏を呼びかける様子が映し出されています。一見すると本物のゼレンスキー氏が映っているようにも見えますが、よく見ると、体のバランスや動き、表情などがぎこちなく、不自然であるため、偽物であることがわかります。

将来、ディープフェイク技術がさらに進化し、本物と偽物の見分けがつかないくらいリアルな映像が作られるようになると、政治家が発言をしているフェイク動画の拡散による国民や社会情勢への影響の大きさは計り知れません。

③FBIが採用面接でのディープフェイク悪用に対する注意を呼びかけ

アメリカ連邦捜査局は、就職のオンライン面接において、ディープフェイクを用いて別人になりすます人が増えているとして、注意を呼びかけています。

FBIの発表によると、リモートでの面接中に、別人の映像や音声を自分に重ね合わせ、別人に成りすまして面接を受ける人が増えているとのことです。

このように、一般人であっても比較的容易にディープフェイクの技術を活用して悪用することができるようになっています。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

ディープフェイクのリスクに対する3つの対策

ディープフェイクのリスクに対する対策として、主に以下の3つが挙げられます。

- ①情報ソースのダブルチェック

- ②社内のAI・セキュリティリテラシーの向上

- ③社内システムのセキュリティ強化

それぞれについてわかりやすく紹介していきます。

※AI総研では経験豊富なコンサルタントによる、生成AI/ChatGPT活用の個別無料相談会を実施しております。自社に合った活用方法や導入の進め方などでお困りの方は、お気軽にご相談ください。

⇒生成AI/ChatGPT活用の個別無料相談会の詳細はこちら

①情報ソースのダブルチェック

少しでもディープフェイクが疑われる映像や音声を見つけた場合には、それを鵜吞みにするのではなく、情報ソースを確認したり、他のサイトでも調べたりするなどして、ダブルチェックをすることで、ディープフェイクに騙されるリスクを回避できます。

特に、過剰に人を煽ったり、物議を醸すような内容の映像や音声はディープフェイクの可能性が比較的高いので注意が必要です。

②社内のAI・セキュリティリテラシーの向上

社員がディープフェイクによって作られた偽の情報にアクセスしてしまうことで、詐欺やウィルス感染の被害に遭うことがないように、日頃から研修や勉強会を開くなどして、社内のAI・セキュリティリテラシーを向上させることが重要です。

③社内システムのセキュリティ強化

社員が誤ってディープフェイクによる偽の情報にアクセスしてしまい、マルウェアやウィルスに感染してしまうこともあります。

そのような場合に備えて、社内システムにウィルス対策ソフトを導入したり、脆弱性管理を定期的に行うなど、セキュリティ対策を万全に施しておくことが重要です。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

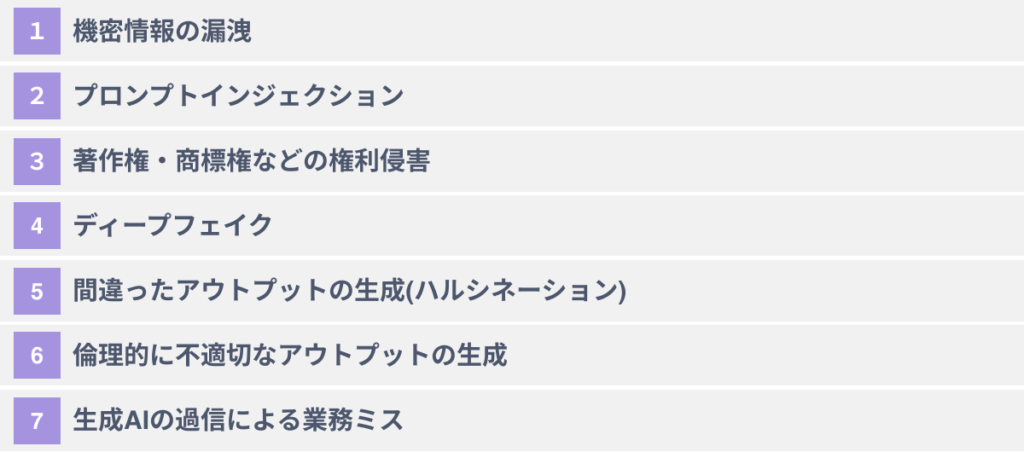

企業が生成AIを活用する際の7大リスク

企業が生成AIを活用する際の代表的なリスクとして以下の7つが挙げられます。

- ①機密情報の漏洩

- ②プロンプトインジェクション

- ③著作権・商標権などの権利侵害

- ④ディープフェイク

- ⑤間違ったアウトプットの生成(ハルシネーション)

- ⑥倫理的に不適切なアウトプットの生成

- ⑦生成AIの過信による業務ミス

それぞれについてわかりやすく紹介していきます。

※生成AI/ChatGPTを導入する前に必ず押さえておきたい、主要なリスクと具体的な対策をまとめた資料をダウンロード頂けます。

⇒生成AI/ChatGPT導入のリスクと対策ガイドブックの資料ダウンロードはこちら(無料)

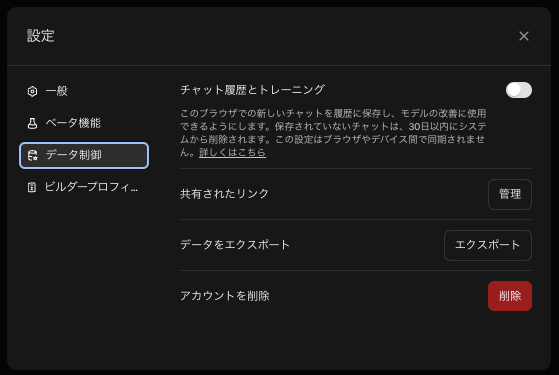

①機密情報の漏洩

各ユーザーが生成AIに入力したデータは、生成AIが学習し進化するために、基本的にはクラウド上で保管されます。

そのため、会社内部の機密情報や顧客の個人情報などを入力してしまうと、生成AIサービス提供者や他のユーザーに機密情報が流出してしまうリスクが存在します。

②プロンプトインジェクション

プロンプトインジェクションとは、悪意あるユーザーが、ChatGPTなどの対話型AIに、特殊な指示や質問を入力することで、本来公開すべきでない機密情報やデータを引き出すサイバー攻撃の一種です。

2023年2月には、米国の大学生がマイクロソフト社のBingに搭載される生成AI検索エンジンに対し、プロンプトインジェクションを行い、非公開の指示やBingチャットの開発用コードネームを引き出すことに成功したなど、実際に機密情報が流出する事例も存在します。

③著作権・商標権などの権利侵害

生成AIの既存の著作物を学習データ活用することは、原則として著作権者の許諾なく可能とされています。

一方で、生成AIによって生成されたコンテンツの公開や販売をする際には、基本的には通常の著作権侵害の検討が適用されます。

生成されたコンテンツに、既存のコンテンツとの類似性や依拠性が認められれば、著作権者は著作権侵害として損害賠償請求・差止請求が可能であるほか、刑事罰の対象となりえます。

④ディープフェイク

ディープフェイクとはディープラーニング技術を活用し、実際に存在しない、人物の動画や画像を生成する技術です。

この技術により、人間が見ても区別がつかないほど高精度なメディアが作成可能となり、そのリアルさから、詐欺やフェイクニュースの拡散などに悪用され、大きな問題となっています。

⑤間違ったアウトプットの生成(ハルシネーション)

生成AIの利用方法によっては、事実と異なる誤った情報/アウトプットを真実のように堂々と生成するハルシネーションという現象が起こります。

例えば、高度な専門性を要する分野での回答や定量データの抽出や計算において、ハルシネーションが多く見られる傾向にあります。

⑥倫理的に不適切なアウトプットの生成

生成AIのアウトプットは学習データの内容に大きく左右されます。

そのため、学習データのボリュームが少なく、内容にバイアスがある場合、人種や性意識に関する差別や憎悪を助長する内容など、倫理的に不適切なアウトプットが生成されてしまうリスクが存在します。

⑦生成AIの過信による業務ミス

生成AIは非常に便利なツールであり、適切に利用することで業務生産性を大きく高めることが可能ですが、どのようなシチュエーションでも万能という訳ではありません。

生成AIは入力データに依存して機能するため、そのデータが不完全だったり偏りを持っていたりすると、生成される結果も誤りを含むことがあります。さらに、生成AIは人間の倫理感覚や判断能力を有していないので、提供する情報が常に正確であるわけではありません。

例えば、生成AIを利用して法的な契約書を作成した場合、誤った法的内容を含む文書が作成されることも考えられます。このような状況では、法的な問題に発展する可能性が高まり、その結果、深刻なトラブルに繋がるリスクがあります。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

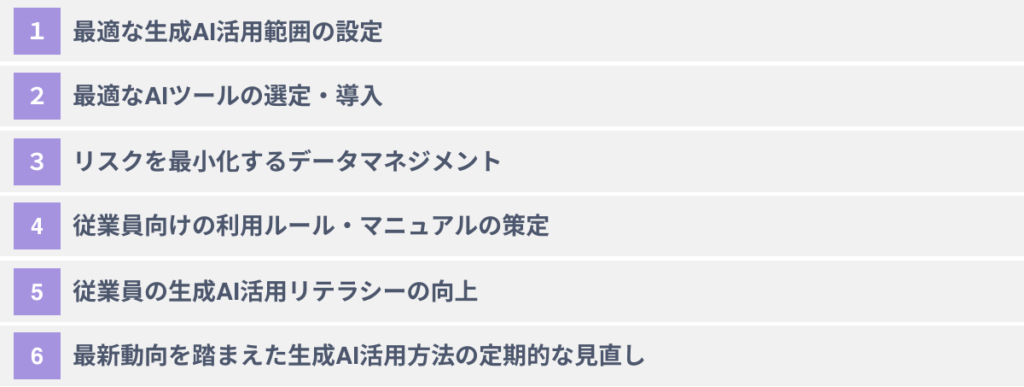

企業が生成AIのリスクに対して取るべき6つの対応策

企業が生成AIのリスクに対して取るべき代表的な対応策として以下の6つが挙げられます。

- ①最適な生成AI活用範囲の設定

- ②最適なAIツールの選定・導入

- ③リスクを最小化するデータマネジメント

- ④従業員向けの利用ルール・マニュアルの策定

- ⑤従業員の生成AI活用リテラシーの向上

- ⑥最新動向を踏まえた生成AI活用方法の定期的な見直し

それぞれについてわかりやすく紹介していきます。

①最適な生成AI活用範囲の設定

生成AIは全ての業務に対して万能という訳ではなく、明確に得意不得意が存在します。

そのため、生成AI活用の成果を最大化し、リスクを最小化するためには、活用する範囲を適切に設定することが極めて重要です。

これにより、不適切な情報生成や不意の法的問題の防止につながります。

②最適なAIツールの選定・導入

各企業の状況や目的に最適なAIツールの選定と導入は、安全かつ効率的なAI活用に向けて非常に重要です。

利用するAIツールは、その機能、性能、セキュリティ対策が自社の要求を満たしているかを評価し、適切なものを選ぶ必要があります。

さらに、AIツールの導入時も、ユーザーが入力した内容を学習させない「オプトアウト」を選択する等の対処を取ることで、自社のリスクを最小化することができます。

※生成AIツールの導入を検討される方に、おすすめの10大生成AIツールの特徴や選び方、活用方法をまとめた資料をダウンロード頂けます。

⇒10大生成AIツール徹底比較の資料ダウンロードはこちら(無料)

③リスクを最小化するデータマネジメント

生成AIは、入力されたデータに基づいて動作するため、データマネジメントの質がAIの出力品質に直結します。

データの正確性、偏りのなさ、機密性の保持は、リスクを最小化する上で極めて重要です。

適切なデータマネジメントの実施により、データの質を確保し、情報漏洩や不正確な情報生成のリスクを低減します。

④従業員向けの利用ルール・マニュアルの策定

生成AIの効果的な利用とリスクの最小化のためには、企業が従業員向けの明確な利用ルールやマニュアルを策定することが重要です。

具体的には、社内でのAIの使用目的、使用範囲、倫理ガイドライン、データ取り扱いのルール・マニュアルを策定する必要があります。

⑤従業員の生成AI活用リテラシーの向上

生成AIのポテンシャルを最大限に活用し、同時にリスクを管理するためには、従業員のAIに関する理解とスキル、すなわちAIリテラシーを向上させることが不可欠です。

研修プログラムや実践的なトレーニングを通じて、従業員が生成AIの基本的な知識、適切な使用方法、関連するリスクを理解してもらい、効率的かつ責任ある方法で使用できる環境を構築することが求められます。

⑥最新動向を踏まえた生成AI活用方法の定期的な見直し

生成AIの技術・サービスは日々進化しており、新たな活用方法や利用プロセスが登場し、それに応じて新たなリスクが生じる可能性が高いです。

したがって、国内外の生成AIに関する最新の動向を常に把握し、企業の生成AI活用方法を定期的に見直し、更新することが必要となります。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

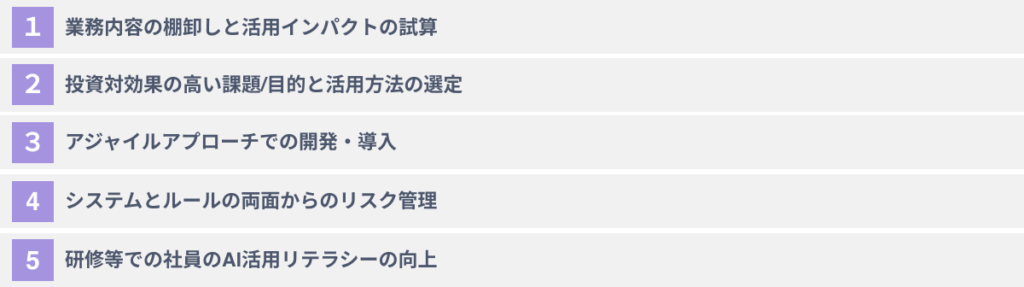

企業が生成AI活用を成功させるための5つのポイント

企業が生成AI活用を成功させるために抑えるべきポイントは以下の5つです。

- ①業務内容の棚卸しと活用インパクトの試算

- ②投資対効果の高い課題/目的と活用方法の選定

- ③アジャイルアプローチでの開発・導入

- ④システムとルールの両面からのリスク管理

- ⑤研修等での社員のAI活用リテラシーの向上

それぞれについてわかりやすく紹介していきます。

※200事例の分析に基づく、企業の生成AI/ChatGPT活用でよくある失敗とベストプラクティスをまとめた資料をダウンロード頂けます。

⇒生成AI/ChatGPT活用しくじり大全の資料ダウンロードはこちら(無料)

①業務内容の棚卸しと活用インパクトの試算

生成AI活用の成否を分ける最大のポイントは、生成AIを活用する意義の大きな業務に対して活用することに尽きます。

活用の方針や戦略がないまま活用を進めるのではなく、自社の業務内容・フローをしっかりと棚卸しした上で、どの程度業務効率やアウトプット向上に繋がるかを試算することが重要となります。

②投資対効果の高い課題/目的と活用方法の選定

生成AIは全ての業務に対して万能という訳ではなく、膨大なデータに基づいたコンテンツ制作は得意だが、複雑な問いに対して正確な答えを出すのは苦手といった、明確な得意不得意が存在します。

そのため、自社の業務の現状や生成AIの特徴を踏まえた上で、どのような課題/目的に対して、どのようなアプローチ/範囲/ツールで活用を進めるかを、検討・選定するステップがプロジェクトの投資対効果を左右する、極めて重要なプロセスとなります。

③アジャイルアプローチでの開発・導入

生成AIは、一度開発・導入して終わりという進め方ではなく、何度もモデル・学習データ・利用方法等を細かくカスタマイズしなおすことで、より理想とする活用を実現することができます。

具体的には、初期仮説に基づいた簡易的なプロトタイプを構築し実際に利用してみる、というサイクルを、1サイクル数週間の期間で何度も繰り返し、ブラッシュアップしていくという、アジャイル開発のアプローチを取ることが適しています。

④システムとルールの両面からのリスク管理

企業が生成AIの活用に踏み切れない最大の理由として、機密情報漏洩や著作権侵害などのリスクへの懸念が挙げられます。

確かに、社員に特段ルールを設けず、一般に公開されている生成AIを活用させた場合、様々な問題が発生する可能性は存在します。

一方で、入力するデータが学習されないようなシステム構築や使用範囲・機密情報の取扱等の運用ルールの策定により、リスクをマネジメントし最小化することが可能です。

⑤研修等での社員のAI活用リテラシーの向上

生成AIの特徴として、AIとの対話によってアウトプットを引き出すことが求められるため、使い手のリテラシーによって成果が大きく左右されることが挙げられます。

そのため、生成AIのポテンシャルを最大限に活用するためには、従業員のAIに対する理解とスキル、すなわちAIリテラシーを向上させることが不可欠です。

研修プログラムや実践的なトレーニングを通じて、従業員に生成AIの基本的な知識、適切な使用方法、関連するリスクを理解してもらい、効率的かつ責任ある方法で使用できる環境の構築が必要となります。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

企業が生成AIを導入するための4つのステップ

企業が生成AIの導入を進めるための流れとして、以下の4つのステップがあげられます。

<Step1:活用方針の検討>

- 最新の市場動向のキャッチアップ

- 自社の活用可能性の整理

- 生成AIの活用目的・ゴールの設定

<Step2:利用環境構築>

- セキュリティ・データ管理体制の強化

- ガイドライン・マニュアルの策定

- 社員向けのAIリテラシー研修

- 社内業務での試験運用

<Step3:試験開発・運用(PoC)>

- PoCを行うユースケースの検討

- 要件定義・プロトタイプ開発

- 運用と評価

<Step4:本開発>

- 本開発を行うユースケースの検討

- 要件定義・本開発

- 運用と評価

- 活用方針・内容の継続的なカイゼン

それぞれについてわかりやすく紹介していきます。

※生成AI/ChatGPTを導入する前に必ず押さえておきたい、基礎知識や導入方法3パターンの比較、リスクと対策などをまとめた資料をダウンロード頂けます。

⇒生成AI/ChatGPT導入マニュアルの資料ダウンロードはこちら(無料)

Step1:活用方針の検討

1つ目のステップは、自社として生成AIをどのように活用していくかの大方針の検討です。

生成AIは社内業務効率化や顧客体験の向上、新規事業創出など様々な目的で活用が可能だからこそ、自社の課題にマッチした目的とユースケースで活用することが、投資対効果を大きく左右します。

最新の技術や競合の動向をキャッチアップした上で、自社の活用可能性の幅出し・整理を行います。その上で、生成AIをどのような領域で、どの程度ダイナミックに活用していくかの目的やゴールを初期的に設定しましょう。

Step2:利用環境構築

2つ目のステップは、生成AIを安全かつ効率的に活用できる、社内のシステムやルールなどの利用環境の構築です。

企業が生成AI活用に踏み切れない理由として、機密情報漏洩などのセキュリティリスクの懸念が挙げられますが、適切なシステム設計・データ管理やガイドラインの策定などを行うことで、それらのリスクに対処しながら、業務効率化に繋げることが可能です。

社員に対し、生成AIをリサーチや文書作成などの日常的な業務に安心して活用できる環境を提供することで、自社のどのような業務と生成AIの相性が良いのかという現場からの示唆を得ることができ、プロトタイプ・本開発の企画への重要なインプットとなります。

Step3:試験開発・運用(PoC)

3つ目のステップは、自社にマッチするユースケースの検証に向けた、プロトタイプの開発と運用です。

顧客対応支援や社内のナレッジ検索、新機能・サービスの実装などの生成AIの幅広いユースケースの中から、自社の経営課題解決にマッチするいくつかのユースケースに絞り込み、プロトタイプを開発し、実際の業務で運用します。

PoCを実施することで、コストを抑えながら生成AI活用のインパクトを検証しつつ、見えてきた改善点から本開発の精度を高めることが可能です。

Step4:本開発と運用

4つ目のステップは、本格的な生成AIを活用したシステムの開発と運用、継続的なカイゼンです。

自社独自のデータ基盤の構築・連携や活用シーンに特化したアウトプット精度の改善などを実施し、自社の目的達成に特化した生成AIシステムを開発します。

PoCの結果を踏まえ、本開発を行うユースケースや活用範囲を決定することで、生成AI活用の費用対効果を最大化することが可能です。

また、開発しっぱなしで終わるのではなく、本開発したシステムを運用し上がった成果や改善点、技術進化などを踏まえて、活用方法や内容を継続的にカイゼンしていくことが重要です。

このプロセスを通じ、生成AI活用のポテンシャルを最大限に発揮することで、業務生産性や顧客への提供価値の観点から、大きな競争優位性を構築することに繋がります。