ChatGPT(チャットGPT)で情報漏洩は起こる?対策~履歴OFF設定法まで

更新日:

ChatGPTは、アメリカの売上上位企業500社のうち、既に80%以上が導入を決定するなど、多くの企業が業務への活用を進めています。

ChatGPTを活用することで業務時間を半分に減らすことに成功した企業も存在するなど、ChatGPTを使いこなせる人と使わない人の差は今後ますます広がっていくでしょう。

一方で、「ChatGPTを利用したいけど、情報漏洩やセキュリティのリスクが気になってなかなか導入に踏み切れない」「ChatGPTで会社の機密情報が流出しないか不安」という悩みを抱えている方も多いのではないでしょうか。

例えば、韓国のサムスン電子では、従業員がChatGPTに機密情報を入力した結果、その情報が社外に流出した事件が発生したことがあります。

そこで本記事では、ChatGPTによる情報漏洩リスクについて、すぐ実践できる具体的な対策とともにわかりやすくご紹介します。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

目次

ChatGPT(チャットGPT)に情報漏洩リスクはある?

結論から言うと、ChatGPTに入力した情報が漏洩するリスクはあります。ChatGPTに入力した情報は、原則として、クラウド上で管理されることになりますが、そのクラウドから情報が流出する可能性があるのです。また、チャット履歴が他のユーザーによって閲覧されたり、アカウント情報が第三者に漏れたりする場合もあります。

例えば、韓国のサムスン電子では、社内エンジニアが社外秘のソースコードをChatGPTにアップロードしたところ、そのコード情報が他のユーザーに開示され、漏洩した事件が発生したことがあります。

もっとも、しっかりと対策を講じることで、ChatGPTの情報漏洩リスクを回避することができます。情報漏洩リスクがあるからという理由でChatGPTの利用をあきらめるのではなく、正しい対処法を学んだうえで、安全に有効活用することが重要です。

※これさえ読めば、ChatGPTの機能・できること・活用方法まで全てわかる、最新情報をまとめた資料をダウンロード頂けます。

⇒【5分でわかる】ChatGPT活用ガイドブックの資料ダウンロードはこちら(無料)

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

ChatGPT(チャットGPT)で情報漏洩が起こる3つのケース

ChatGPTで情報漏洩が発生するケースにはいくつかのパターンがあります。最も典型的なものとして以下の3つが挙げられます。

- ①ChatGPTに入力した個人情報・機密情報の流出

- ②チャット履歴の情報の流出

- ③ChatGPTのアカウント情報の流出

それぞれについてわかりやすく紹介していきます。

※AI/ChatGPTを導入する前に必ず押さえておきたい、主要なリスクと具体的な対策をまとめた資料をダウンロード頂けます。

⇒AI/ChatGPT導入のリスクと対策ガイドブックの資料ダウンロードはこちら(無料)

①ChatGPTに入力した個人情報・機密情報の流出

ChatGPTに入力した情報は、ChatGPTが学習するために、基本的にはクラウド上で保管されます。

そのため、会社内部の機密情報や顧客の個人情報などを入力してしまうと、サービス提供者や他のユーザーに機密情報が流出・漏洩してしまうリスクが存在します。

②チャット履歴の情報の流出

ChatGPTと対話した内容は、チャット履歴として記録され、あとから閲覧することができます。

特に、1つのアカウントを複数人で共有している場合には、他のユーザーが自由にチャット履歴を閲覧することができるため、情報流出・漏洩の危険が高まります。

③ChatGPTのアカウント情報の流出

ChatGPTを利用するためには、メールアドレスとパスワードを設定してアカウントを作成する必要があります。

アカウント情報の管理を怠ると、自分のメールアドレスやパスワードが漏洩し、その結果、第三者に勝手にChatGPTを使われてしまうおそれがあります。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

ChatGPT(チャットGPT)での情報漏洩を防ぐ7つの方法

ChatGPTで情報漏洩を防ぐための方法として、主に以下の7つが挙げられます。

- ①パスワードを定期的に更新する

- ②機密情報や個人情報を入力しない

- ③チャット履歴をOFFにする(オプトアウト)

- ④従業員向けに利用ルールを作る

- ⑤ChatGPT API版やEnterpriseプランを利用する

- ⑥ChatGPT搭載サービスを利用する

- ⑦Azure OpenAI Serviceを利用する

それぞれについてわかりやすく紹介していきます。

※AI/ChatGPTを導入する前に必ず押さえておきたい、基礎知識や導入方法3パターンの比較、リスクと対策などをまとめた資料をダウンロード頂けます。

⇒AI/ChatGPT導入マニュアルの資料ダウンロードはこちら(無料)

①パスワードを定期的に更新する

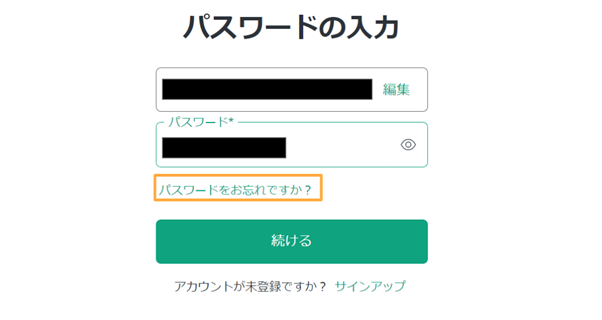

ChatGPTにログインするためのパスワードが漏洩すると、第三者に勝手に自分のアカウントが使われ、今までのチャット履歴を見られてしまうリスクがあります。

そのため、ChatGPTのログインパスワードを厳重に保管するとともに、定期的にパスワードを変更しておくことが重要です。

ChatGPTのパスワードは、ChatGPTへのログインの際に表示されるパスワードを入力する画面において、「パスワードをお忘れですか?」という箇所をクリックすることで変更することができます。

②機密情報や個人情報を入力しない

ChatGPTに入力した情報の漏洩によるトラブルを防ぐ最も確実な手段は、ChatGPTに個人情報や機密情報を入力しないことです。

個人情報や機密情報に該当する部分は「XXX」などとマスキングすることなどの対応をとることで、情報漏洩を防ぎつつ、ChatGPTを有効に活用することができます。

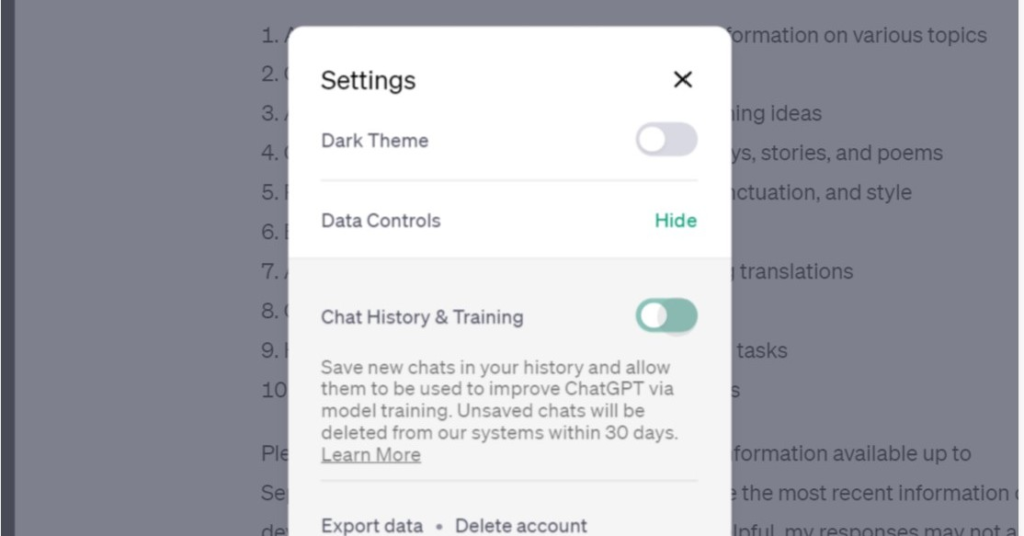

③チャット履歴をOFFにする(オプトアウト)

ChatGPTには、対話内容の履歴をオフにするオプトアウトと呼ばれる機能があります。これにより、入力した情報がChatGPTに学習されなくなり、履歴としても残らないので、情報漏洩のリスクを回避することができます。

対話内容の履歴は、ChatGPTの設定画面から簡単にオンオフを切り替えることができます。詳しいやり方は、以下の記事で分かりやすく紹介しています。

⇒ChatGPTのオプトアウト機能とは?情報漏洩を防ぐ設定方法を紹介

④従業員向けに利用ルールを作る

ChatGPTを社内で導入する場合には、従業員向けに明確な利用ルールやマニュアルを策定することが重要です。

そのマニュアルにおいて、ChatGPTの情報漏洩リスクと具体的な対策・注意点を明記し、従業員に周知徹底することで、前述のサムスン電子のように、従業員が機密情報をChatGPTに入力して、その情報が漏洩してしまうといった事故を防ぐことができます。

また、AI総研では、企業様の個別の目的や課題に即したオーダーメイドのChatGPT/AI活用マニュアル・利用ガイドラインの策定を支援しています。ChatGPT/AIのマニュアル作成について相談されたい方は、お気軽にお問い合わせください。

⑤ChatGPT API版やEnterpriseプランを利用する

ChatGPTには、様々なプランや活用方法があり、プラン・方法ごとにセキュリティの強さが異なります。中でも、OpenAIが公開しているChatGPTのAPIを利用する方法と、ChatGPT Enterpriseプランを利用する方法は、情報漏洩リスクを回避する有効な手段となります。

ChatGPTをAPI連携して活用すれば、入力した情報がChatGPTに学習されないため、情報漏洩のリスクを回避することができます。

また、ChatGPT Enterpriseプランは、米国公認会計士協会(AICPA)が開発した、高水準のセキュリティを維持するための国際的な基準である、SOC 2に準拠するレベルのセキュリティを実現しており、情報漏洩のリスクが最小限に抑えられています。

⑥ChatGPT搭載サービスを利用する

現在、多くの日本企業がChatGPTを搭載した議事録作成ツールや要約・翻訳ツール、チャットボットなどのサービスを提供しています。これらのサービスは企業向けにも提供されており、情報保護にも配慮した高度なセキュリティ環境を備えているものも多いです。

そのため、ChatGPTそのものではなく、ChatGPTを搭載したサービスを利用するのも、情報漏洩リスクを回避する有効な手段となるでしょう。

特に、日本企業が提供しているサービスは、UIもわかりやすく設計されているため、従業員が正しい方法で使えるようになっています。また、カスタマーサポートも充実しているため、仮に情報流出等のトラブルがあった場合には、サービス提供者側に対応方法を相談することもできます。

※生成AIツールの導入を検討される方に、ChatGPTを含む10大生成AIツールの特徴や選び方、活用方法をまとめた資料をダウンロード頂けます。

⇒10大生成AIツール徹底比較の資料ダウンロードはこちら(無料)

⑦Azure OpenAI Serviceを利用する

Azure OpenAI Serviceとは、Microsoftが提供する、クラウド上で利用可能なChatGPT導入環境構築サービスです。

ChatGPTのモデルであるGPT-3.5やGPT-4を社内のシステムやアプリケーションに組み込むためのツールであり、高度なセキュリティ環境のもとでChatGPTを導入できるというメリットがあります。

具体的には、データの暗号化、アクセス制御、監査ログなどのセキュリティ機能が備わっており、企業や組織が機密情報や個人情報を保護しながらChatGPTを活用することを支援します。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

ChatGPT(チャットGPT)で情報漏洩が起こった事例3選

ChatGPTで情報漏洩が起こった事例として、以下の3つが挙げられます。

- ①サムスンの社内ソースコードが生成AI経由で外部に流出

- ②日本のChatGPTアカウント661件が闇取引市場で売買される

- ③ChatGPTの一部ユーザーの情報が他のユーザーからも閲覧できるバグが発生

それぞれの事例についてわかりやすく紹介していきます。

※200事例の分析に基づく、企業のAI/ChatGPT活用でよくある失敗とベストプラクティスをまとめた資料をダウンロード頂けます。

⇒AI/ChatGPT活用しくじり大全の資料ダウンロードはこちら(無料)

①サムスンの社内ソースコードが生成AI経由で外部に流出

生成AI活用による代表的な企業の情報漏洩事例として韓国サムスン電子での情報漏洩が挙げられます。

サムスン電子は、従業員によるChatGPTなどの生成人工知能(AI)ツールの利用を禁止する新ポリシーを策定しました。

これは、従業員がChatGPTにセンシティブなデータをアップロードし、誤って情報をリークさせた事例が発覚したためです。

詳細な内容は不明ですが、エンジニアが社内ソースコードをChatGPTにアップロードし、外部サーバーに保存されたデータが他のユーザーに開示されたことが背景にあるとされています。

新たなポリシーは、社内のコンピューターやタブレット、携帯電話、社内ネットワークでの生成AIシステムの使用を禁止し、個人所有の端末でChatGPTなどを利用する場合には、サムスンの知的財産や会社関連の情報、個人データを入力しないよう要求しています。

②日本のChatGPTアカウント661件が闇取引市場で売買される

シンガポールの情報セキュリティ会社Group-IBは、日本からChatGPTのログイン情報(IDとパスワード)が漏洩していると発表しました。

グループIBは、ウェブブラウザなどに保存された情報を盗み出すマルウェア「インフォスティーラー」によってこの漏洩を検知しました。

2023年5月までの1年間で、ChatGPTのアカウントがダークウェブの闇市場で取引されており、その中で少なくとも661件が日本からの漏洩であることが確認されています。

③ChatGPTの一部ユーザーの情報が他のユーザーからも閲覧できるバグが発生

OpenAIは、2023年3月24日に公式ホームページにおいて、とある情報漏洩トラブルが発生したと発表しました。そのトラブルとは、3月20日のある時間帯にChatGPTの有料プラン「ChatGPT Plus」を利用していた一部のユーザーの個人情報が漏洩した可能性があるとのことでした。

ある時間帯にChatGPTを利用していたアクティブユーザーの名前、メールアドレス、クレジットカード番号の下4桁と有効期限といった情報を、他のユーザーが閲覧できる状態になっていたようです。全ユーザーの約1.2%の情報が対象になったとのことです。

OpenAIは、この事象の原因について、ChatGPTのインメモリデータベースである「Redis」においてバグが発生したことによるものであると説明しています。

OpenAIは、問題の発生を受け、すぐにRedisのメンテナンス担当者と連携し、必要な対策を施したとのことです。