ChatGPTの注意すべきポリシー違反5選|回避方法や事例も紹介

更新日:

ChatGPTを提供しているOpenAIは、ユーザーがChatGPTを安全に利用できるようにするためにポリシーを定め、差別的な表現の入力を禁止したり、著作権を侵害する利用を禁止しています。

このポリシーに違反すると、アカウントの停止や法的措置などの対象になる可能性があるため、ポリシーをしっかりと遵守してChatGPTを利用することが重要です。

そこで本記事では、ChatGPTを利用する上で注意すべきポリシー違反について、回避方法とともにわかりやすくご紹介します。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

目次

ChatGPTのポリシーとは

ChatGPTのポリシーとは、ChatGPTの提供元であるOpenAI社が定める利用規約やガイドラインのことです。

ChatGPTは基本的には適切な回答を出力しますが、まれに差別的な表現や性的な表現などの不適切な内容が含まれていたり、著作権を侵害するようなコンテンツが生成されることがあります。

このような事態を防ぐため、OpenAI社は、ChatGPTに読み込ませるデータや回答に含める内容に不適切な表現が含まれないようにルールを定め、ユーザーが安心してChatGPTを利用できるようにしています。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

ChatGPTの注意すべきポリシー違反5選

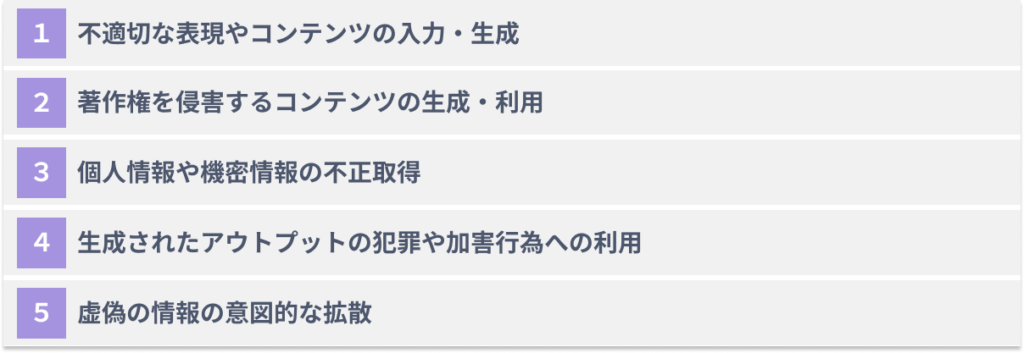

ChatGPTを利用する際には、OpenAI社のポリシーを遵守する必要があります。ポリシーに違反すると、アカウントが停止されたり、法的措置が講じられる可能性があります。特に注意すべきポリシー違反として、以下の5つが挙げられます。

- ①不適切な表現やコンテンツの入力・生成

- ②著作権を侵害するコンテンツの生成・利用

- ③個人情報や機密情報の不正取得

- ④生成されたアウトプットの犯罪や加害行為への利用

- ⑤虚偽の情報の意図的な拡散

それぞれについてわかりやすく紹介していきます。

※これさえ読めば、ChatGPTの機能・できること・活用方法まで全てわかる、最新情報をまとめた資料をダウンロード頂けます。

⇒【5分でわかる】ChatGPT活用ガイドブックの資料ダウンロードはこちら(無料)

①不適切な表現やコンテンツの入力・生成

ChatGPTに対して、差別的な表現や性的に不快な表現、倫理に反する表現など、不適切な言葉を入力したり、回答させたりすることは、ポリシーに違反する場合があります。

②著作権を侵害するコンテンツの生成・利用

ChatGPTが生成したコンテンツについてOpenAI社は著作権を放棄しているので、ChatGPTが生成した文章を記事として投稿したり、ChatGPTが生成した画像を商用利用する行為が、OpenAI社の著作権を侵害することはありません。

しかし、ChatGPTが生成したコンテンツが他社のコンテンツと類似している場合には、これを利用することは、他社の著作権の侵害に当たる可能性があります。OpenAI社はこのような著作権侵害行為をポリシーとして禁止しているので、注意が必要です。

③個人情報や機密情報の不正取得

ChatGPTに個人情報や機密情報を聞き出すような質問をする行為は、個人情報保護法などの法律にも違反し得る行為であり、OpenAI社のポリシーでも規制されています。

④生成されたアウトプットの犯罪や加害行為への利用

ChatGPTが生成したアウトプットを犯罪や加害行為に利用することも禁止されています。例えば、ChatGPTに詐欺のための文言を生成させたり、他人を脅す言葉を作成する行為などは、ポリシーで固く禁止されています。

⑤虚偽の情報の意図的な拡散

ChatGPTも全知全能の万能ツールではないため、生成した回答に誤りが含まれている場合もあります。

ChatGPTが生成した回答が誤りであると分かって、意図的に拡散する行為は、ポリシーにより規制されています。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

ChatGPTのポリシー違反を回避する3つの方法

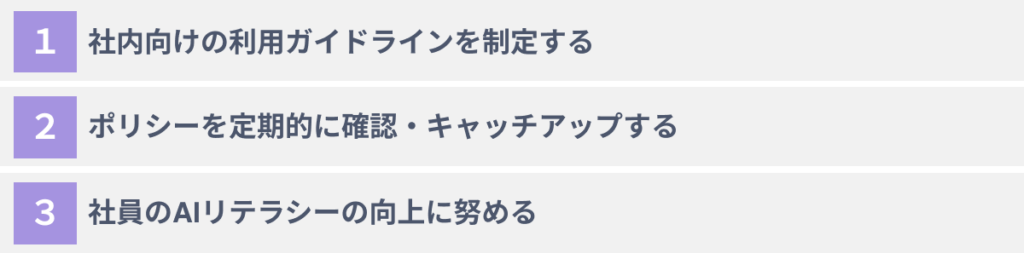

ChatGPTのポリシー違反を回避する方法として、以下の3つが挙げられます。

- ①社内向けの利用ガイドラインを制定する

- ②ポリシーを定期的に確認・キャッチアップする

- ③社員のAIリテラシーの向上に努める

それぞれについてわかりやすく紹介していきます。

※AI/ChatGPTを導入する前に必ず押さえておきたい、基礎知識や導入方法3パターンの比較、リスクと対策などをまとめた資料をダウンロード頂けます。

⇒AI/ChatGPT導入マニュアルの資料ダウンロードはこちら(無料)

①社内向けの利用ガイドラインを制定する

ChatGPTを社員に利用させる場合には、事前に社内向けの利用ガイドラインを策定し、社員に遵守させることが重要です。

利用ガイドラインには、OpenAI社のポリシーの内容を反映させるとともに、会社の業務に応じた独自のルールを定める必要があります。

②ポリシーを定期的に確認・キャッチアップする

ChatGPTのポリシーは、法令の変更やユーザーからの意見等により、継続的に更新されます。

そのため、定期的にポリシーを確認し、最新の内容をキャッチアップしておくことが重要です。

OpenAI社の最新の利用規約は、こちらから確認することができます。

③社員のAIリテラシーの向上に努める

ChatGPTのポリシーに記載されている内容は、一般的にAIを活用する際に注意すべき事項と共通する部分が多くなっています。

そのため、社員に対して研修や勉強会を行い、AIのリスクや注意点について学習させ、AIリテラシーを向上させることで、適切な利用を促すことができます。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

ChatGPTの問題事例3選

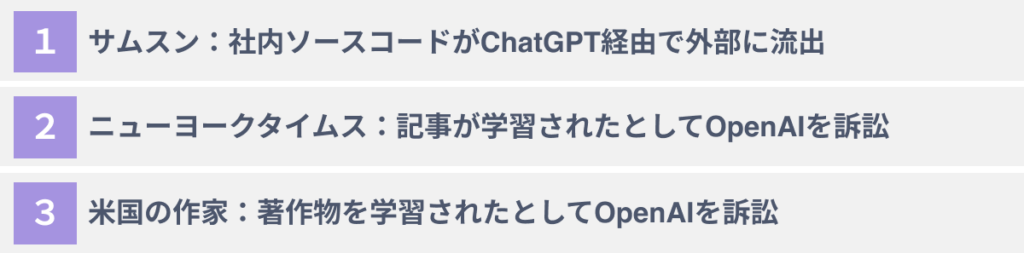

ChatGPTの問題事例として、以下の3つが挙げられます。

- ①サムスン:社内ソースコードがChatGPT経由で外部に流出

- ②ニューヨークタイムス:記事が学習されたとしてOpenAIを訴訟

- ③米国の作家:著作物を学習されたとしてOpenAIを訴訟

それぞれについてわかりやすく紹介していきます。

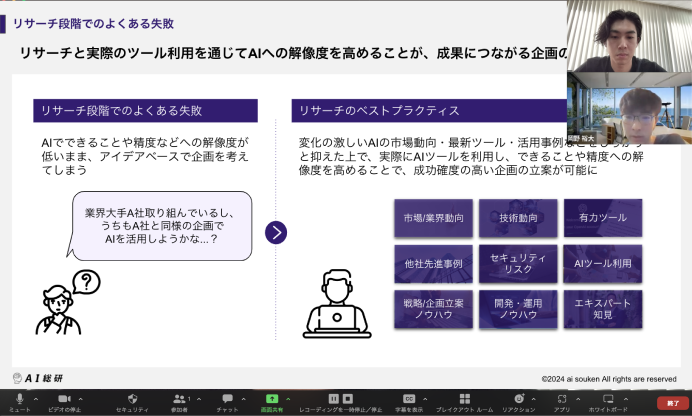

※200事例の分析に基づく、企業のAI/ChatGPT活用でよくある失敗とベストプラクティスをまとめた資料をダウンロード頂けます。

⇒AI/ChatGPT活用しくじり大全の資料ダウンロードはこちら(無料)

①サムスン:社内ソースコードがChatGPT経由で外部に流出

生成AI活用による代表的な企業の情報漏洩事例として韓国サムスン電子での情報漏洩が挙げられます。

サムスン電子は、従業員によるChatGPTなどの生成人工知能(AI)ツールの利用を禁止する新ポリシーを策定しました。

これは、従業員がChatGPTにセンシティブなデータをアップロードし、誤って情報をリークさせた事例が発覚したためです。

詳細な内容は不明ですが、エンジニアが社内ソースコードをChatGPTにアップロードし、外部サーバーに保存されたデータが他のユーザーに開示されたことが背景にあるとされています。

新たなポリシーは、社内のコンピューターやタブレット、携帯電話、社内ネットワークでの生成AIシステムの使用を禁止し、個人所有の端末でChatGPTなどを利用する場合には、サムスンの知的財産や会社関連の情報、個人データを入力しないよう要求しています。

②ニューヨークタイムス:記事が学習されたとしてOpenAIを訴訟

ニューヨーク・タイムズがオープンAIとマイクロソフトに対し、「数十億ドル」の損害賠償責任を求める形で訴訟を提起しました。

同紙は、インターネット上の膨大なデータを分析して「学習」するChatGPTが、許可なく同紙の記事を利用し、購読料収入及び広告収入の機会を奪っていると主張。この訴訟は、AIの利用と著作権の保護という点で新たな議論を呼び起こしています。

③米国の作家:著作物を学習されたとしてOpenAIを訴訟

「ゲーム・オブ・スローンズ」の作者ジョージ・R・R・マーティン氏などの作家たちは、ChatGPTが自身の著作権を侵害しているとして、その開発元であるOpenAIに対して訴訟を起こしました。

この訴訟では、ChatGPTが作家たちの許可なく著作物のデータを使用していることが問題視されています。

一方、OpenAIも、作家の権利を尊重していると説明。「作家らもAI技術から利益を得るべきだ」との考えを表明しており、今後の動向に注目が集まっています。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

企業がChatGPTをビジネスに活用する7つのリスク

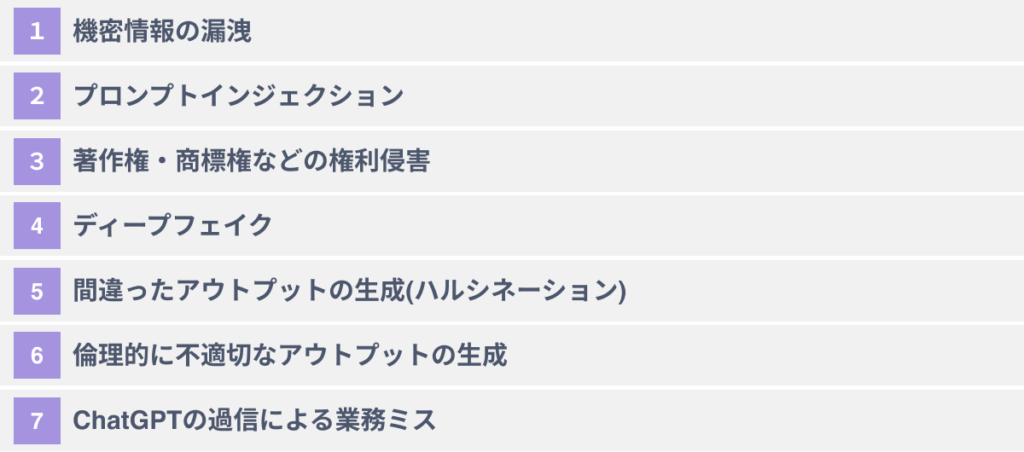

ChatGPTを活用する7つのリスクとして以下の7つが挙げられます。

- ①機密情報の漏洩

- ②プロンプトインジェクション

- ③著作権・商標権などの権利侵害

- ④ディープフェイク

- ⑤間違ったアウトプットの生成(ハルシネーション)

- ⑥倫理的に不適切なアウトプットの生成

- ⑦ChatGPTの過信による業務ミス

それぞれについてわかりやすく紹介していきます。

※AI/ChatGPTを導入する前に必ず押さえておきたい、主要なリスクと具体的な対策をまとめた資料をダウンロード頂けます。

⇒AI/ChatGPT導入のリスクと対策ガイドブックの資料ダウンロードはこちら(無料)

①機密情報の漏洩

各ユーザーがChatGPTに入力したデータは、生成AIが学習し進化するために、基本的にはクラウド上で保管されます。

そのため、会社内部の機密情報や顧客の個人情報などを入力してしまうと、生成AIサービス提供者や他のユーザーに機密情報が流出してしまうリスクが存在します。

②プロンプトインジェクション

プロンプトインジェクションとは、悪意あるユーザーが、ChatGPTなどの対話型AIに、特殊な指示や質問を入力することで、本来公開すべきでない機密情報やデータを引き出すサイバー攻撃の一種です。

2023年2月には、米国の大学生がマイクロソフト社のBingに搭載される生成AI検索エンジンに対し、プロンプトインジェクションを行い、非公開の指示やBingチャットの開発用コードネームを引き出すことに成功したなど、実際に機密情報が流出する事例も存在します。

③著作権・商標権などの権利侵害

ChatGPTの既存の著作物を学習データとして活用することは、原則として著作権者の許諾なく可能とされています。

一方で、ChatGPTによって生成されたコンテンツの公開や販売をする際には、基本的には通常の著作権侵害の検討が適用されます。

生成されたコンテンツに、既存のコンテンツとの類似性や依拠性が認められれば、著作権者は著作権侵害として損害賠償請求・差止請求が可能であるほか、刑事罰の対象となりえます。

④ディープフェイク

ディープフェイクとはディープラーニング技術を活用し、実際に存在しない、人物の動画や画像を生成する技術です。

この技術により、人間が見ても区別がつかないほど高精度なメディアが作成可能となり、そのリアルさから、詐欺やフェイクニュースの拡散などに悪用され、大きな問題となっています。

⑤間違ったアウトプットの生成(ハルシネーション)

ChatGPTの利用方法によっては、事実と異なる誤った情報/アウトプットを真実のように堂々と生成するハルシネーションという現象が起こります。

例えば、高度な専門性を要する分野での回答や定量データの抽出や計算において、ハルシネーションが多く見られる傾向にあります。

⑥倫理的に不適切なアウトプットの生成

ChatGPTのアウトプットは学習データの内容に大きく左右されます。

そのため、学習データのボリュームが少なく、内容にバイアスがある場合、人種や性意識に関する差別や憎悪を助長する内容など、倫理的に不適切なアウトプットが生成されてしまうリスクが存在します。

⑦ChatGPTの過信による業務ミス

ChatGPTは非常に便利なツールであり、適切に利用することで業務生産性を大きく高めることが可能ですが、どのようなシチュエーションでも万能という訳ではありません。

ChatGPTは入力データに依存して機能するため、そのデータが不完全だったり偏りを持っていたりすると、生成される結果も誤りを含むことがあります。さらに、生成AIは人間の倫理感覚や判断能力を有していないので、提供する情報が常に正確であるわけではありません。

例えば、ChatGPTを利用して法的な契約書を作成した場合、誤った法的内容を含む文書が作成されることも考えられます。このような状況では、法的な問題に発展する可能性が高まり、その結果、深刻なトラブルに繋がるリスクがあります。

AI総研では、社員様のAI活用促進に課題がある企業様に対して、助成金を活用して最大75%オフになる大変お得な実践型AI研修サービスを提供しご好評いただいています。

ChatGPTの問題点/リスクに対してとるべき6つの対応策

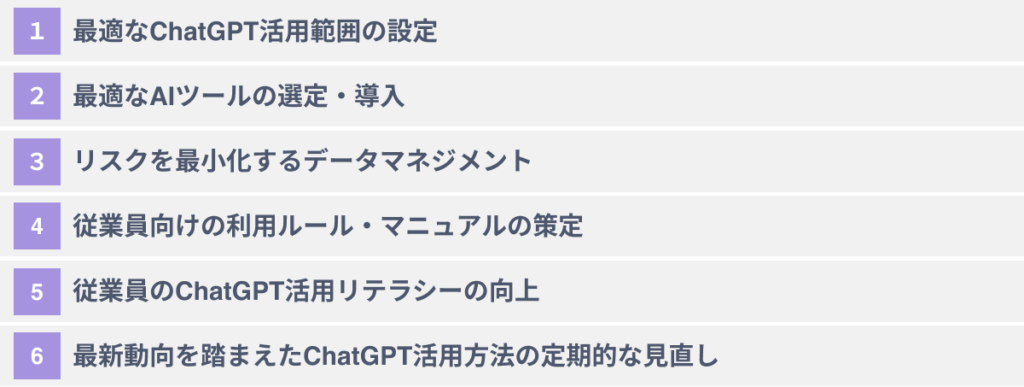

ChatGPTの問題点/リスクに対してとるべき対応策として以下の6つが挙げられます。

- ①最適なChatGPT活用範囲の設定

- ②最適なAIツールの選定・導入

- ③リスクを最小化するデータマネジメント

- ④従業員向けの利用ルール・マニュアルの策定

- ⑤従業員のChatGPT活用リテラシーの向上

- ⑥最新動向を踏まえたChatGPT活用方法の定期的な見直し

それぞれについてわかりやすく紹介していきます。

※AI/ChatGPTの活用を検討する際に必ず押さえておきたい、基礎知識から活用の進め方、ポイントまでをまとめた資料をダウンロード頂けます。

⇒【ゼロから分かる】AI/ChatGPT活用ガイドブックの資料ダウンロードはこちら(無料)

①最適なChatGPT活用範囲の設定

ChatGPTは全ての業務に対して万能という訳ではなく、明確に得意不得意が存在します。

そのため、ChatGPT活用の成果を最大化し、リスクを最小化するためには、活用に活用する範囲を適切に設定することが極めて重要です。

これにより、不適切な情報生成や不意の法的問題の防止につながります。

②最適なAIツールの選定・導入

各企業の状況や目的に最適なAIツールの選定と導入は、安全かつ効率的なAI活用に向けて非常に重要です。

ChatGPTを活用し構築された様々なAIツールの中から、その機能、性能、セキュリティ対策が自社の要求を満たしているかを評価し、適切なものを選ぶ必要があります。

さらに、AIツールの導入時も、ユーザーが入力した内容を学習させない「オプトアウト」を選択する等の対処を取ることで、自社のリスクを最小化することができます。

※生成AIツールの導入を検討される方に、ChatGPTを含む10大生成AIツールの特徴や選び方、活用方法をまとめた資料をダウンロード頂けます。

⇒10大生成AIツール徹底比較の資料ダウンロードはこちら(無料)

③リスクを最小化するデータマネジメント

ChatGPTは、入力されたデータに基づいて動作するため、データマネジメントの質がChatGPTの出力品質に直結します。

データの正確性、偏りのなさ、機密性の保持は、リスクを最小化する上で極めて重要です。

適切なデータマネジメントの実施により、データの質を確保し、情報漏洩や不正確な情報生成のリスクを低減します。

④従業員向けの利用ルール・マニュアルの策定

ChatGPTの効果的な利用とリスクの最小化のためには、企業が従業員向けの明確な利用ルールやマニュアルを策定することが重要です。

具体的には、社内でのAIの使用目的、使用範囲、倫理ガイドライン、データ取り扱いのルール・マニュアルを策定する必要があります。

⑤従業員のChatGPT活用リテラシーの向上

ChatGPTのポテンシャルを最大限に活用し、同時にリスクを管理するためには、従業員のAIに関する理解とスキル、すなわちAIリテラシーを向上させることが不可欠です。

研修プログラムや実践的なトレーニングを通じて、従業員がChatGPTの基本的な知識、適切な使用方法、関連するリスクを理解してもらい、効率的かつ責任ある方法で使用できる環境を構築することが求められます。

⑥最新動向を踏まえたChatGPT活用方法の定期的な見直し

ChatGPTの技術・サービスは日々進化しており、新たな活用方法や利用プロセスが登場し、それに応じて新たなリスクが生じる可能性が高いです。

したがって、国内外のChatGPTに関する最新の動向を常に把握し、企業のChatGPT活用方法を定期的に見直し、更新することが必要となります。